百度などの研究者が「性能王」LiDARをハッキング、自動運転の安全性を巡り波紋が広がる

自動運転車は「偽の道しるべ」にミスリードされて、対向車線にはみ出してしまうだけでなく、道の真ん中にある障害物を無視し、避けきれなくなるまで気付かない。

最近、百度がミシガン大学、イリノイ大学と共同で発表した研究レポートは、自動運転車の安全性に大きな疑問を投げかけている。今回は、最も性能の良い「性能王」センサーと言われているLiDARまでハッキングされてしまった。

レーザレーダーによる目標検出は、現在自動運転車で用いられている主流の手法であり、このようなセンサーは精度が高く、コストが高く、技術的なハードルが高い。高い値段で安全が買えるようになれば、その価値も認められる。しかし最近、百度研究院、ミシガン大学、イリノイ大学アーバナ・シャンペーン校の研究者が、レーザーレーダーポイントクラウドを「騙す」ことができる対抗策を提案し、レーザーレーダーの安全性に疑問を呈している。

ディープラーニングでは、ニューラルネットワークのロバスト性を検出するために、特定の方法では識別・判断しにくい何らかのターゲットを生成してニューラルネットワークを攻撃することが一般的であり、これらのターゲットを「対抗サンプル」と呼ぶ。対抗サンプルは、通常は入念に設計されたインプットであり、小幅な摂動を伴うものであり、ニューラルネットワークの誤った予測を誘導することを目的としている。

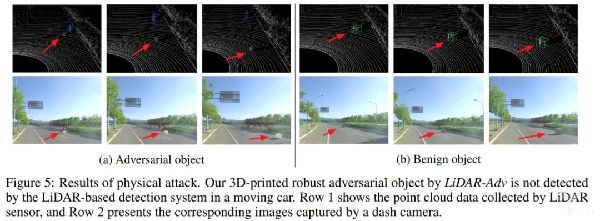

上記の数人の研究者も対抗サンプルを作成しているが、今回はレーザーレーダーを狙ったものだ。 彼らの提案する対抗方法はLiDAR−Advと呼ばれ、この方法で生成された対抗サンプルを視覚化すると、次の図のような奇妙な物体が得られる。

物理対照実験のために、彼らは別に普通の段ボールを用意し、対抗サンプルと普通の段ボールをそれぞれ自動運転車の進路の中央と右側に置き、レーザーレーダーの反応を見た。

まず、進路の中央に対抗サンプルと普通の段ボールを置いた。その結果,レーザーレーダーは、離れている距離から通常の段ボールを検出したのに対して、対抗サンプルについては、なかり近づくまでこのターゲットを検出しなかった。

つぎに、道路の右側に対抗サンプルと普通の段ボールを配置した。物体を進路の右側に置くとさらに状況は悪くなり、レーザーレーダーは対抗サンプルをそのまま「無視」した。

今回の実験結果は、自動運転車の安全性に大きな疑問を投げかけている。